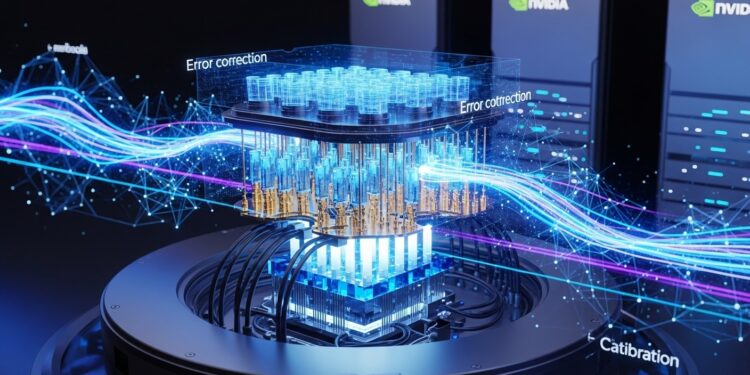

Imaginez un monde où les ordinateurs quantiques, ces machines aux promesses infinies, ne restent plus prisonniers de leurs fragilités. Aujourd’hui, une avancée majeure vient d’ébranler les fondations de l’informatique du futur. NVIDIA a dévoilé une innovation qui pourrait bien accélérer de plusieurs années l’arrivée d’ordinateurs quantiques véritablement utiles. Au cœur de cette révolution : une famille de modèles d’intelligence artificielle open-source spécialement conçus pour surmonter les deux plus grands obstacles techniques du domaine.

Une nouvelle ère pour le calcul quantique

Le calcul quantique fascine depuis des décennies. Il promet de résoudre des problèmes complexes que les supercalculateurs classiques mettent des siècles à traiter. Pourtant, malgré des progrès impressionnants dans la construction de qubits, ces unités de base quantiques restent extrêmement sensibles aux perturbations. Le bruit environnemental, les imperfections matérielles et les erreurs de calcul freinent encore le passage à l’échelle industrielle.

C’est précisément sur ces défis que se concentre la nouvelle initiative de NVIDIA. En combinant l’intelligence artificielle avec les besoins spécifiques du quantique, l’entreprise ouvre une voie inédite. Les modèles baptisés Ising ne se contentent pas d’assister ; ils deviennent le cerveau qui pilote et stabilise les systèmes quantiques.

« L’IA est essentielle pour rendre le calcul quantique pratique. Avec Ising, l’IA devient le plan de contrôle, le système d’exploitation des machines quantiques, transformant des qubits fragiles en systèmes quantiques-GPU scalables et fiables. »

Cette vision audacieuse marque un tournant. Au lieu de considérer l’IA comme un outil périphérique, elle est placée au centre de l’architecture quantique. Les chercheurs et les entreprises disposent désormais d’outils puissants pour transformer les prototypes expérimentaux en plateformes opérationnelles.

Les deux grands défis du quantique enfin adressés

Pour qu’un ordinateur quantique devienne utile à grande échelle, deux verrous majeurs doivent être levés. Le premier concerne la calibration des processeurs. Chaque qubit doit être précisément accordé, une opération délicate qui, jusqu’à présent, pouvait prendre des jours, voire des semaines, de travail manuel intensif. Le second défi réside dans la correction des erreurs. Les qubits sont si sensibles que les erreurs apparaissent constamment ; il faut les détecter et les corriger en temps réel sans ralentir le calcul.

Les modèles Ising s’attaquent directement à ces deux bottlenecks. D’un côté, le modèle de calibration automatise et accélère considérablement le processus de tuning. De l’autre, le modèle de décodage optimise la correction d’erreurs avec une efficacité inédite. Ensemble, ils forment une solution complète qui rapproche le quantique d’applications concrètes dans la médecine, la finance, la logistique ou encore la découverte de matériaux.

Ising Calibration : l’automatisation intelligente des processeurs quantiques

Ising Calibration représente une prouesse technique. Il s’agit d’un modèle de vision-langage de 35 milliards de paramètres, capable d’interpréter les données expérimentales issues des processeurs quantiques. Au lieu de procéder par ajustements manuels itératifs, ce modèle analyse les mesures, infère les actions nécessaires et propose des corrections automatisées.

Les workflows de calibration, qui exigeaient autrefois plusieurs jours de configuration experte, se réduisent désormais à quelques heures. Cette accélération n’est pas seulement une question de temps ; elle permet aussi d’expérimenter plus rapidement, d’itérer sur des architectures plus complexes et de maintenir les systèmes en condition optimale de manière continue.

Grâce à une approche agentique, le modèle peut agir de manière autonome ou en collaboration avec des chercheurs. Il s’adapte aux spécificités de chaque processeur quantique, qu’il soit basé sur des qubits supraconducteurs, piégés ou photoniques. Cette flexibilité ouvre la porte à une personnalisation fine sans compromettre la propriété intellectuelle des données.

Ising Decoding : une correction d’erreurs révolutionnaire

Le décodage des erreurs constitue l’un des aspects les plus critiques du calcul quantique fault-tolerant. Les codes de surface, largement étudiés, nécessitent un décodage rapide et précis pour identifier et corriger les erreurs avant qu’elles ne propagent. Traditionnellement, des algorithmes classiques comme pyMatching servaient de référence, mais leurs performances limitaient l’échelle.

Ising Decoding change la donne. Ce framework basé sur un réseau de neurones convolutionnel 3D propose deux variantes : l’une optimisée pour la vitesse, l’autre pour la précision. Les résultats sont impressionnants : jusqu’à 2,5 fois plus rapide et 3 fois plus précis que les benchmarks open-source actuels.

Cette amélioration permet de gérer des codes de surface de plus grande distance, donc plus robustes. Le décodage en temps réel devient réalisable, condition sine qua non pour exécuter des algorithmes quantiques longs et complexes sans accumulation d’erreurs irrécupérables.

Les modèles Ising Decoding surpassent l’état de l’art en offrant une performance inédite sur les modèles de bruit dépolarisant, tout en proposant un cadre d’entraînement flexible pour s’adapter à n’importe quel modèle de bruit spécifique.

Une stratégie open-source audacieuse

En rendant ces modèles entièrement open-source, NVIDIA adopte une approche collaborative inédite dans le domaine quantique. Les poids pré-entraînés, les frameworks d’entraînement, les datasets et les outils de fine-tuning sont disponibles sur GitHub, Hugging Face et la plateforme build.nvidia.com. Cette ouverture permet à la communauté mondiale de bâtir sur des fondations solides plutôt que de repartir de zéro.

Les intégrations avec CUDA-Q et NVLink facilitent l’hybridation entre calcul classique et quantique. Les chercheurs peuvent ainsi développer des workflows complets où l’IA classique pilote, optimise et corrige le composant quantique en temps réel. Un véritable « système d’exploitation » pour les machines quantiques émerge.

Cette stratégie bénéficie déjà à de nombreux acteurs. Des laboratoires nationaux américains comme Fermi et Lawrence Berkeley, des universités prestigieuses telles que Harvard ou UC San Diego, des entreprises comme IQM Quantum Computers, ou encore des institutions européennes et asiatiques ont commencé à explorer ces outils. La diversité des early adopters témoigne de l’intérêt transversal pour cette technologie.

Les implications techniques profondes

Pour bien comprendre l’impact, il faut plonger dans les détails techniques. Le modèle de calibration utilise une architecture vision-langage qui traite à la fois les données visuelles (comme les spectres ou les diagrammes de calibration) et les descriptions textuelles des expériences. Cette multimodalité permet une compréhension nuancée des comportements quantiques souvent contre-intuitifs.

Du côté du décodage, les réseaux convolutionnels 3D exploitent la structure spatiale des codes de surface. Ils apprennent à reconnaître les motifs d’erreurs dans un espace tridimensionnel, améliorant significativement la détection par rapport aux méthodes graphiques traditionnelles. Le framework d’entraînement inclus permet de générer des modèles adaptés à des modèles de bruit spécifiques, qu’ils soient réalistes ou hypothétiques.

Ces avancées ne sont pas isolées. Elles s’inscrivent dans une vision plus large où l’IA devient le contrôleur universel des systèmes quantiques. Les qubits restent fragiles par nature, mais l’intelligence artificielle les rend gérables à grande échelle.

Vers des applications concrètes et la cryptographie

Les retombées potentielles sont immenses. Dans le domaine de la découverte de médicaments, un ordinateur quantique précis pourrait simuler des molécules complexes avec une fidélité inégalée. En optimisation, les problèmes de logistique ou de portefeuille financier trouveraient des solutions plus rapides et plus efficaces.

Du côté de la cryptographie, l’avancée dans la correction d’erreurs rapproche le moment où des ordinateurs quantiques « cryptographiquement pertinents » pourraient menacer les standards actuels comme RSA ou les courbes elliptiques. Bien que l’échéance reste lointaine, chaque gain en précision et en vitesse du décodage réduit ce délai. Les acteurs de la blockchain et de la cybersécurité suivent donc ces développements avec une attention particulière.

Pourtant, il ne s’agit pas seulement d’une menace. Les mêmes technologies quantiques pourraient renforcer la sécurité via des protocoles de cryptographie post-quantique ou des communications quantiques sécurisées. L’équilibre entre opportunités et risques évolue rapidement.

Le positionnement stratégique de NVIDIA

Cette annonce renforce encore le rôle central de NVIDIA dans l’écosystème technologique. Leader incontesté des GPU pour l’IA classique, l’entreprise étend désormais son empire à l’interface entre classique et quantique. En fournissant à la fois le hardware (via CUDA-Q) et les modèles logiciels open-source, elle crée un écosystème cohérent où les développeurs peuvent passer fluidement d’un paradigme à l’autre.

Les nouvelles en provenance de NVIDIA ont souvent un impact sur les marchés, y compris celui des cryptomonnaies liées à l’IA. Avec Ising, une nouvelle verticale « quantum AI » s’ajoute, potentiellement porteuse de nouvelles dynamiques pour les tokens et projets blockchain qui intègrent des composants quantiques ou hybrides.

Les perspectives d’avenir et les défis restants

Malgré ces progrès remarquables, de nombreux défis persistent. La scalabilité vers des millions de qubits fiables reste un horizon lointain. Les modèles de bruit réels sont souvent plus complexes que les simulations, et l’intégration physique entre les composants classiques et quantiques pose encore des problèmes d’ingénierie.

Cependant, en rendant les outils accessibles et en favorisant la collaboration ouverte, NVIDIA accélère la courbe d’apprentissage collective. Les contributions de la communauté permettront sans doute d’améliorer encore les performances, d’étendre les cas d’usage et de découvrir de nouvelles architectures hybrides.

Les prochaines étapes pourraient inclure l’intégration plus poussée avec d’autres frameworks quantiques, le support de nouvelles plateformes hardware, ou même l’entraînement de modèles plus grands adaptés à des architectures spécifiques. L’écosystème quantique entre dans une phase d’accélération inédite.

Pourquoi cette annonce marque-t-elle un tournant historique ?

Historiquement, le calcul quantique a souvent été perçu comme un domaine réservé aux physiciens et aux laboratoires nationaux. Avec l’arrivée de modèles IA open-source performants, la barrière d’entrée s’abaisse considérablement. Des startups, des universités de taille moyenne et même des entreprises innovantes peuvent désormais expérimenter sans disposer d’équipes entières d’experts en calibration manuelle.

Cette démocratisation pourrait générer une explosion d’innovations similaires à ce que l’on a vu avec l’IA générative après l’ouverture de modèles comme ceux de la famille GPT. Le quantique, longtemps cantonné à la recherche fondamentale, pourrait entrer dans une phase d’application pratique plus rapide que prévu.

| Aspect | Avant Ising | Avec Ising |

|---|---|---|

| Temps de calibration | Plusieurs jours | Quelques heures |

| Vitesse de décodage | Benchmark pyMatching | Jusqu’à 2,5x plus rapide |

| Précision du décodage | Standard open-source | Jusqu’à 3x plus précise |

| Accessibilité | Expertise lourde requise | Open-source et fine-tunable |

Ce tableau illustre concrètement les gains apportés. Bien sûr, les chiffres réels dépendront des implémentations spécifiques, mais les ordres de grandeur soulignent l’ampleur de la percée.

L’impact sur l’écosystème technologique global

L’annonce dépasse le seul cadre du calcul quantique. Elle illustre comment l’IA peut servir de multiplicateur de force pour d’autres technologies émergentes. Dans un monde où les données explosent et où la complexité des systèmes augmente, l’IA devient l’outil universel d’optimisation et de contrôle.

Pour les développeurs, cela signifie de nouvelles opportunités de carrière à l’intersection de l’IA, de la physique quantique et de l’ingénierie logicielle. Les formations en quantum machine learning gagneront en attractivité. Les entreprises qui investissent tôt dans ces compétences hybrides pourraient prendre une longueur d’avance décisive.

Sur le plan sociétal, les applications futures pourraient transformer des secteurs entiers. De la modélisation climatique plus précise à l’optimisation des réseaux énergétiques, en passant par la cryptanalyse ou la simulation de matériaux supraconducteurs, les retombées potentielles touchent presque tous les domaines de la vie moderne.

Conclusion : vers un futur quantique accéléré

L’arrivée de NVIDIA Ising ne constitue pas seulement une amélioration incrémentale. Elle représente un changement de paradigme où l’intelligence artificielle devient le pilier indispensable du calcul quantique scalable. En rendant ces outils open-source, l’entreprise invite la communauté mondiale à participer activement à cette révolution.

Les mois et les années à venir seront passionnants. Les premiers retours d’expérience des early adopters, les améliorations communautaires et les nouvelles intégrations hardware dessineront progressivement le paysage du quantique pratique. Une chose est certaine : les qubits fragiles d’aujourd’hui ont trouvé un allié puissant dans l’IA.

Alors que nous nous approchons lentement mais sûrement de l’ère des ordinateurs quantiques utiles, des questions éthiques, de sécurité et de gouvernance émergeront inévitablement. Comment réguler une technologie qui pourrait à la fois résoudre les grands défis de l’humanité et remettre en cause certains équilibres géopolitiques ou économiques ? Les débats ne font que commencer.

Pour l’instant, saluons cette avancée technique remarquable qui démontre une fois de plus la puissance de l’innovation lorsqu’elle combine ouverture, collaboration et vision à long terme. Le futur du calcul quantique s’écrit aujourd’hui, ligne de code par ligne de code, qubit par qubit.

Restez attentifs : les prochaines annonces dans ce domaine pourraient bien redéfinir les limites de ce que nous considérons comme possible en informatique. L’aventure ne fait que commencer, et elle s’annonce extraordinaire.