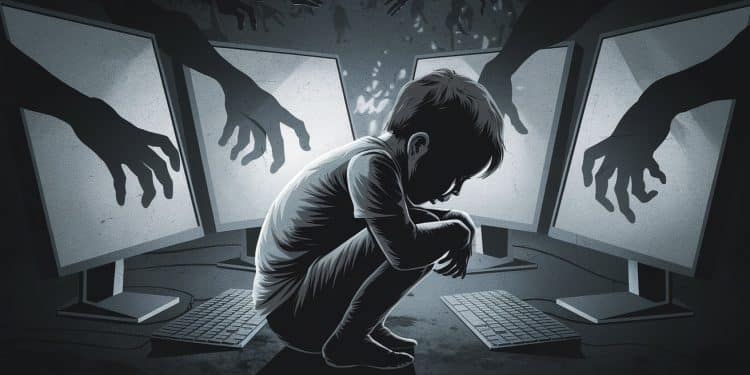

Un nouveau fléau se répand tel un virus dans les tréfonds du web. L’intelligence artificielle (IA) générative, cette technologie révolutionnaire capable de créer du contenu à partir de simples instructions, est détournée à des fins abjectes par des réseaux pédocriminels. Des milliers d’images et de vidéos représentant des violences sexuelles sur des enfants, générées entièrement par IA, inondent des forums clandestins. Une vague déferlante qui soulève l’indignation des associations de protection de l’enfance.

L’IA Nourrit les Fantasmes les Plus Sombres

Depuis l’avènement des outils d’IA grand public comme Dall-E ou Midjourney, la création de contenus pédopornographiques connaît une croissance exponentielle. Selon des sources proches du dossier, plus de 20 000 images auraient été publiées en un mois sur un seul forum du dark web. Une hausse colossale par rapport aux années précédentes. L’entraînement de ces IA ne nécessite que quelques photos « innocentes » d’enfants en maillot de bain glanées sur les réseaux sociaux. De quoi générer à l’infini des visuels d’un réalisme glaçant, mettant en scène de jeunes victimes virtuelles.

La Frontière Entre Virtuel et Réalité s’Estompe

Si aucun enfant n’est directement abusé dans la production de ces images, leur prolifération n’en reste pas moins dangereuse. Comme le souligne la Fondation pour l’Enfance dans un rapport accablant, ces contenus « contribuent à la banalisation des pratiques pédocriminelles et à l’objectification de l’enfant ». Pire encore, ils nourrissent les fantasmes toxiques des consommateurs, les incitant à rechercher des contenus de plus en plus violents et extrêmes.

Les profils des personnes qui visionnent ces contenus sont différents mais quand il y a eu un passage à l’acte, très souvent, il y a eu avant un visionnage.

Angèle Lefranc, chargée de plaidoyer de la Fondation pour l’enfance

Selon les estimations de l’Office des Mineurs, dans 40% des affaires de pédocriminalité, la consultation de ce type de contenu serait un facteur déclencheur du passage à l’acte. Un lien de causalité qui fait froid dans le dos.

Un Casse-tête pour les Autorités

Outre les risques pour les enfants, ces images générées par IA compliquent grandement le travail d’identification des victimes réelles par les forces de l’ordre. Distinguer le vrai du faux devient un défi titanesque à mesure que la technologie progresse. Les enquêteurs craignent que ce flot d’images virtuelles ne noie les preuves de véritables abus, ralentissant leur traque des prédateurs.

Un Vide Juridique à Combler d’Urgence

Face à ce phénomène, le cadre légal peine à s’adapter. Bien que moralement condamnable, la création de contenu pédopornographique virtuel évolue encore dans un vide juridique en France. Un angle mort dans lequel s’engouffrent les pédocriminels les plus tech-savvy. La Fondation pour l’Enfance appelle à une réponse rapide et coordonnée du législateur pour endiguer ce fléau numérique avant qu’il ne prenne une ampleur incontrôlable.

L’IA Doit Rester un Outil, Pas une Arme

L’intelligence artificielle, malgré ses immenses promesses, se révèle être une arme à double tranchant. Son détournement par des esprits malveillants soulève des questions éthiques brûlantes. Il est urgent de réguler son utilisation et de sensibiliser le grand public aux dérives potentielles. Car derrière chaque image générée se cache la banalisation inacceptable de la souffrance des plus vulnérables. Une société qui laisse prospérer ce fléau sans réagir est une société qui faillit à son devoir de protéger ses enfants.